Infraestrutura de IA

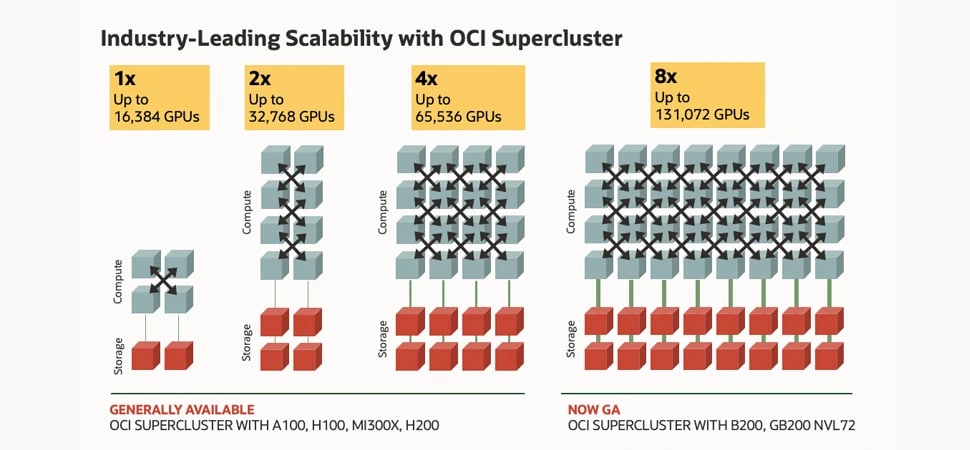

Execute as cargas de trabalho de IA mais exigentes com mais rapidez, incluindo treinamento e inferência de modelos de fronteira, IA autônoma, computação científica e sistemas de recomendação, em qualquer lugar em nossa nuvem distribuída. Use o Oracle Cloud Infrastructure (OCI) Supercluster para até 131.072 GPUs para desempenho em zettascale.

Junte-se à Oracle no NVIDIA GTC

16 a 19 de março de 2026

San Jose, CA e virtual

-

![]() Explore as tendências de IA que afetarão os negócios em 2026

Explore as tendências de IA que afetarão os negócios em 2026

Participe da nossa série de webinars para saber como sua organização pode se preparar.

-

![]() Primeiros princípios: OCI Superclusters Zettascale

Primeiros princípios: OCI Superclusters Zettascale

Os principais arquitetos da OCI revelam como as redes de cluster impulsionam o GenAI escalável, de algumas GPUs a um OCI Supercluster em zettascale com 131.072 GPUs NVIDIA Blackwell.

![]() IA em ação: 10 inovações de ponta para explorar

IA em ação: 10 inovações de ponta para explorar

Descubra 10 tecnologias inovadoras baseadas em IA que estão transformando a forma como as organizações realizam manutenção, interagem com os clientes, protegem dados, prestam serviços de saúde e muito mais.

-

![]() Enterprise Strategy Group sobre AMD Instinct MI300X

Enterprise Strategy Group sobre AMD Instinct MI300X

Descubra a perspectiva do analista sobre a infraestrutura de IA da OCI com GPUs AMD e como essa combinação pode melhorar a produtividade, acelerar o tempo de valorização e reduzir os custos de energia.

Coinovação da Oracle e da NVIDIA

Descubra como as duas empresas estão acelerando a adoção da IA.

Por que executar na infraestrutura de IA da OCI?

Desempenho e valor

Aumente o treinamento de IA com instâncias bare metal de GPU exclusivas da OCI e rede de cluster RDMA ultrarrápida que reduzem a latência para apenas 2,5 microssegundos. Obtenha melhores preços em VMs de GPU.

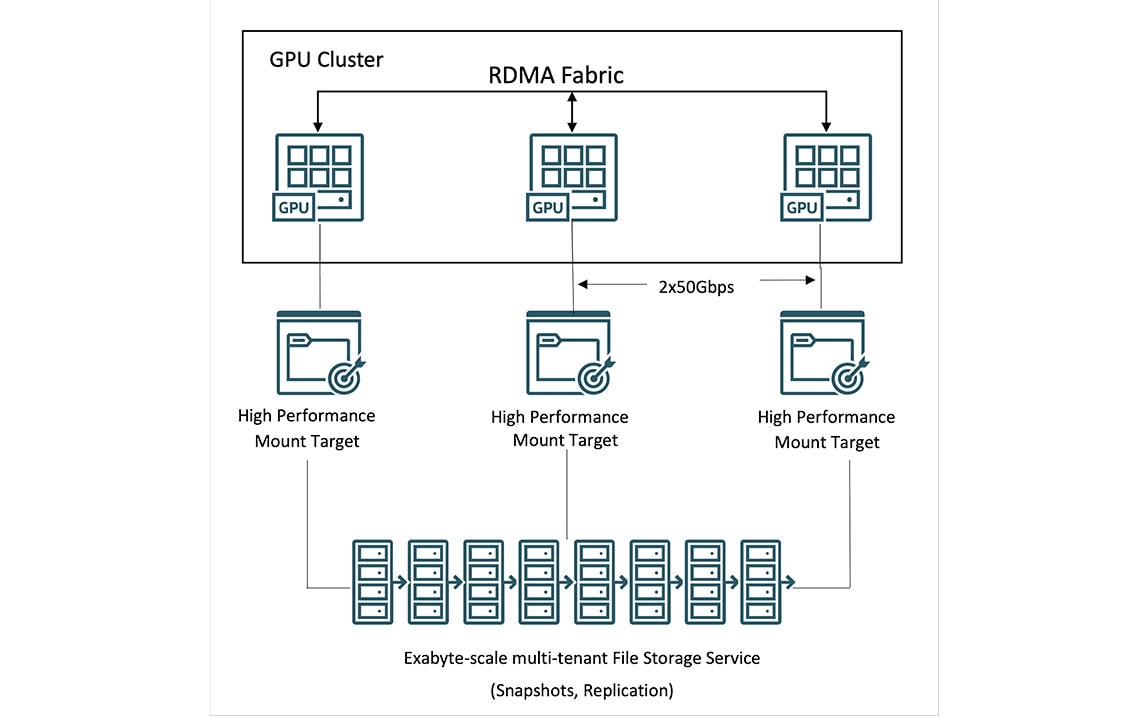

Armazenamento HPC

Aproveite o OCI File Storage com High Performance Mount Targets (HPMT) e Lustre para obter uma taxa de transferência de terabytes por segundo. Use até 61,44 TB de capacidade de armazenamento NVMe, a mais alta do setor para instâncias de GPU.

IA soberana

A nuvem distribuída da Oracle permite que você implemente infraestrutura de IA em qualquer lugar para ajudar a atender aos requisitos de desempenho, segurança e soberania de IA. Saiba como a Oracle e a NVIDIA oferecem IA soberana em qualquer lugar.

A imagem mostra caixas que representam computação e armazenamento, conectadas por linhas para rede de clusters. Na extrema esquerda, há quatro caixas de computação e duas para armazenamento para o menor cluster com 16.000 GPUs NVIDIA H100. À direita, há 8 caixas de computação e 4 caixas de armazenamento para 32.000 GPUs NVIDIA A100 em um cluster. Em seguida, há 16 caixas de computação e 8 caixas de armazenamento para 64.000 GPUs NVIDIA H200. Finalmente, à extrema direita, existem 32 caixas de computação e 16 caixas de armazenamento para 128.000 GPUs NVIDIA Blackwell e Grace Blackwell. Isso mostra a escalabilidade do OCI Supercluster aumentando em 8 vezes, desde a menor configuração de 16.000 GPUs na extrema esquerda até a maior configuração de 128.000 GPUs na extrema direita.

A imagem mostra caixas que representam computação e armazenamento, conectadas por linhas para rede de clusters. Na extrema esquerda, há quatro caixas de computação e duas para armazenamento para o menor cluster com 16.000 GPUs NVIDIA H100. À direita, há 8 caixas de computação e 4 caixas de armazenamento para 32.000 GPUs NVIDIA A100 em um cluster. Em seguida, há 16 caixas de computação e 8 caixas de armazenamento para 64.000 GPUs NVIDIA H200. Finalmente, à extrema direita, existem 32 caixas de computação e 16 caixas de armazenamento para 128.000 GPUs NVIDIA Blackwell e Grace Blackwell. Isso mostra a escalabilidade do OCI Supercluster aumentando em 8 vezes, desde a menor configuração de 16.000 GPUs na extrema esquerda até a maior configuração de 128.000 GPUs na extrema direita.

OCI Supercluster com GPUs NVIDIA Blackwell e Hopper

Até 131.072 GPUs, 8X mais escalabilidade

As inovações da malha da rede permitem que o OCI Supercluster seja dimensionado para até 131.072 GPUs NVIDIA B200, mais de 100.000 GPUs Blackwell em NVIDIA Grace Blackwell Superchips e 65.536 GPUs NVIDIA H200.

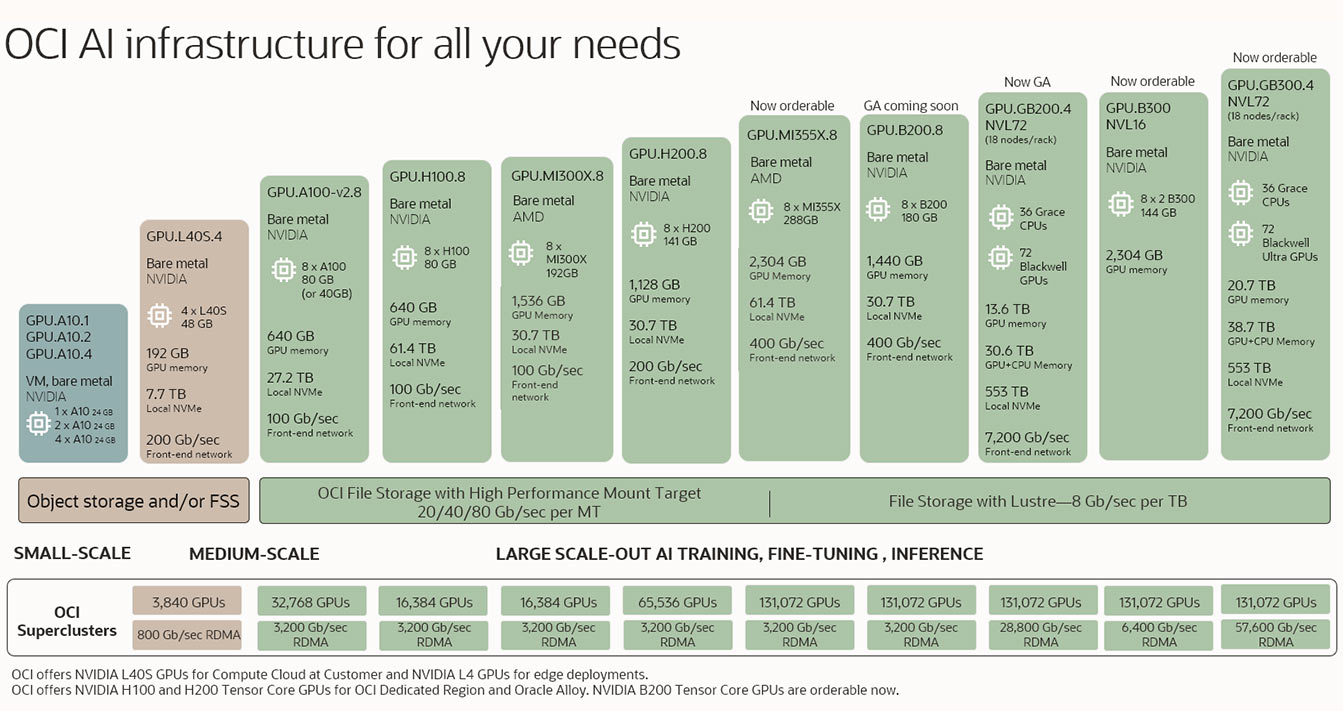

Infraestrutura da OCI AI para todas as suas necessidades

Não importa se você está procurando realizar inferência, ajustar ou treinar modelos de grande escala para IA generativa; a OCI oferece opções de cluster de GPU bare metal e máquina virtual líderes no setor, alimentadas por uma rede de largura de banda ultra-alta e armazenamento de alto desempenho para atender às suas necessidades de IA.

A imagem mostra vários produtos para a Infraestrutura de IA começando na parte inferior esquerda com as menores configurações, aumentando progressivamente para configurações de média e grande escala. As menores configurações são com apenas 1 GPUs em uma máquina virtual e as maiores configurações são para mais de 100.000 GPUs em clusters RDMA.

A imagem mostra vários produtos para a Infraestrutura de IA começando na parte inferior esquerda com as menores configurações, aumentando progressivamente para configurações de média e grande escala. As menores configurações são com apenas 1 GPUs em uma máquina virtual e as maiores configurações são para mais de 100.000 GPUs em clusters RDMA. Anúncio da disponibilidade geral do OCI Compute com GPUs AMD MI355X

Explore o OCI Supercluster para treinamento de IA em larga escala

Clusters massivos e escaláveis com NVIDIA Blackwell e Hopper

Computação sobrecarregada

• Instâncias bare metal sem sobrecarga de hipervisor

• Acelerada por NVIDIA Blackwell (GB200 NVL72, HGX B200),

Hopper (H200, H100) e GPUs de geração anterior

• Opção de usar GPUs AMD MI300X

• Unidade de processamento de dados (DPU) para aceleração de hardware integrada

Capacidade massiva e armazenamento de alto rendimento

• Armazenamento local: até 61,44 TB de capacidade de SSD NVMe

• Armazenamento de arquivos: Armazenamento de arquivos gerenciado pela Oracle com Lustre e destinos de montagem de alto desempenho.

• Armazenamento em bloco: volumes balanceados, de alto desempenho e de desempenho ultra-alto com um SLA de desempenho

• Armazenamento de objetos: níveis de classe de armazenamento distintos, replicação de bucket e limites de alta capacidade

Rede ultrarrápida

• RDMA personalizado sobre protocolo Ethernet convergente (RoCE v2)

• 2,5 a 9,1 microssegundos de latência para rede de cluster

• Até 3.200 Gb/s de largura de banda de rede de cluster

• Até 400 Gb/s de largura de banda de rede front-end

Computação para o OCI Supercluster

As instâncias bare metal da OCI com tecnologia NVIDIA GB200 NVL72, NVIDIA B200, NVIDIA H200, AMD MI300X, NVIDIA L40S, NVIDIA H100 e NVIDIA A100 permitem que executar grandes modelos de IA para casos de uso que incluem deep learning IA conversacional e IA generativa.

Com o OCI Supercluster, você pode expandir para mais de 100.000 Superchips GB200, 131.072 GPUs B200, 65.536 GPUs H200, 32.768 GPUs A100, 16.384 GPUs H100, 16.384 GPUs MI300X e 3.840 GPUs L40S por cluster.

Ampliar+

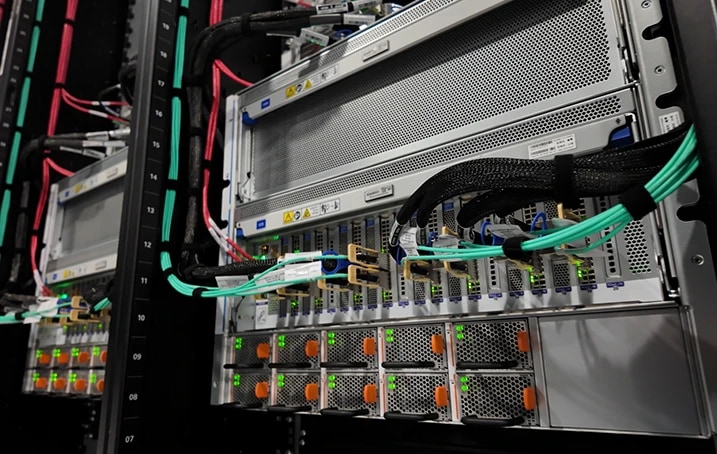

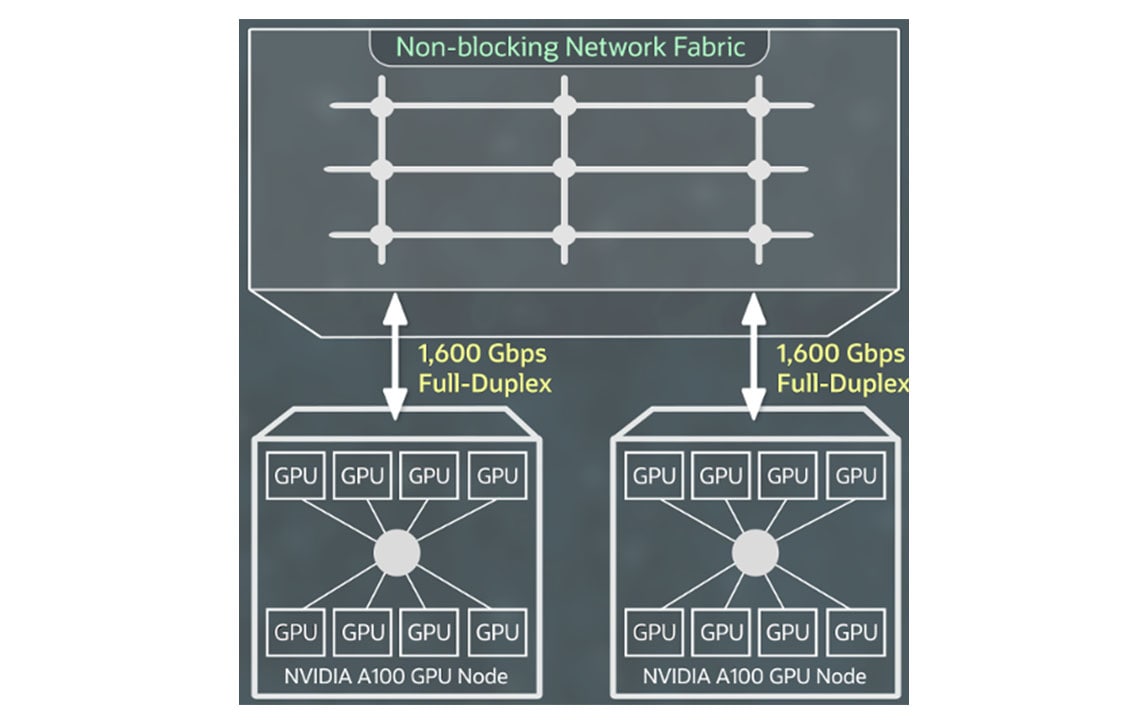

Rede para o OCI Supercluster

A rede de cluster RDMA de alta velocidade alimentada por placas de interface de rede NVIDIA ConnectX com RDMA sobre Ethernet convergente versão 2 permite que você crie grandes clusters de instâncias de GPU com a mesma rede de latência ultrabaixa e escalabilidade de aplicações que você espera on-premises.

Você não paga mais pelo recurso RDMA, armazenamento em blocos ou largura de banda da rede, e os primeiros 10 TB de saída são gratuitos.

Ampliar+

Armazenamento para o OCI Supercluster

Por meio do OCI Supercluster, os clientes podem acessar armazenamento local, em blocos, em objetos e de arquivos para computação em escala de petabytes. Entre os principais provedores de nuvem, a OCI oferece a mais alta capacidade de armazenamento NVMe local de alto desempenho para checkpoint mais frequente durante as execuções de treinamento, resultando em recuperação mais rápida de falhas.

Para grandes conjuntos de dados, a OCI oferece armazenamento de arquivos de alto desempenho com Lustre e pontos de acesso NFS. Os sistemas de arquivos HPC, como BeeGFS, GlusterFS e WEKA, podem ser usados para treinamento de IA em escala sem comprometer o desempenho.

OCI Superclusters Zettascale

Veja os principais arquitetos da OCI revelarem como as redes de cluster alimentam a IA generativa escalável. De algumas GPUs a OCI Superclusters Zettascale com mais de 131.000 GPUs NVIDIA Blackwell, as redes de cluster oferecem alta velocidade, baixa latência e uma rede resiliente para sua jornada de IA.

A Seekr escolheu a Oracle Cloud Infrastructure para fornecer IA confiável para clientes empresariais e governamentais em todo o mundo

Abel Habtegeorgis, Relações Públicas, OracleA Seekr, uma empresa de inteligência artificial focada em fornecer IA confiável, firmou um acordo plurianual com a Oracle Cloud Infrastructure (OCI) para acelerar rapidamente as implementações de IA empresarial e executar uma estratégia conjunta de entrada no mercado.

Leia a publicação completaBlogs em destaque

- 26 DE MARÇO DE 2025 Anunciando novos recursos de infraestrutura de IA com NVIDIA Blackwell para nuvens públicas, on-premises e de provedores de serviços

- 17 de março de 2025 Promovendo a inovação em IA: NVIDIA AI Enterprise e NVIDIA NIM na OCI

- 17 de março de 2025 Oracle e NVIDIA entregam IA soberana em qualquer lugar

- 11 de março de 2025 Vá além da IA — Implemente suas cargas de trabalho de IA rapidamente na OCI

Casos de uso típicos de infraestrutura de IA

- Treinamento e inferência de aprendizado profundo

- Detecção de fraude aumentada por IA

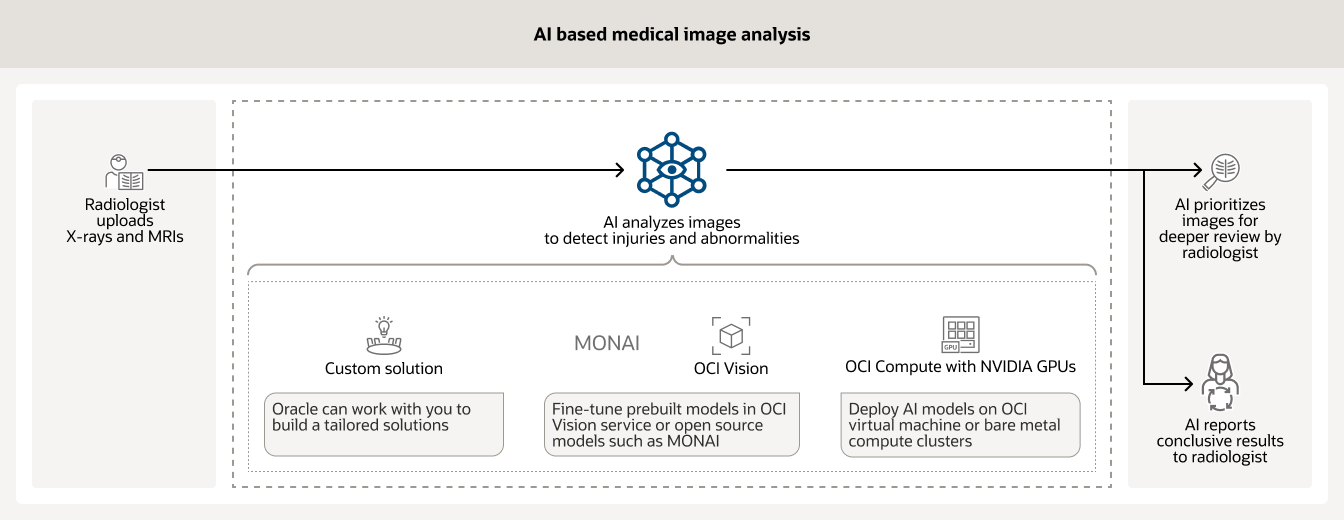

- Análise de imagem médica baseada em IA

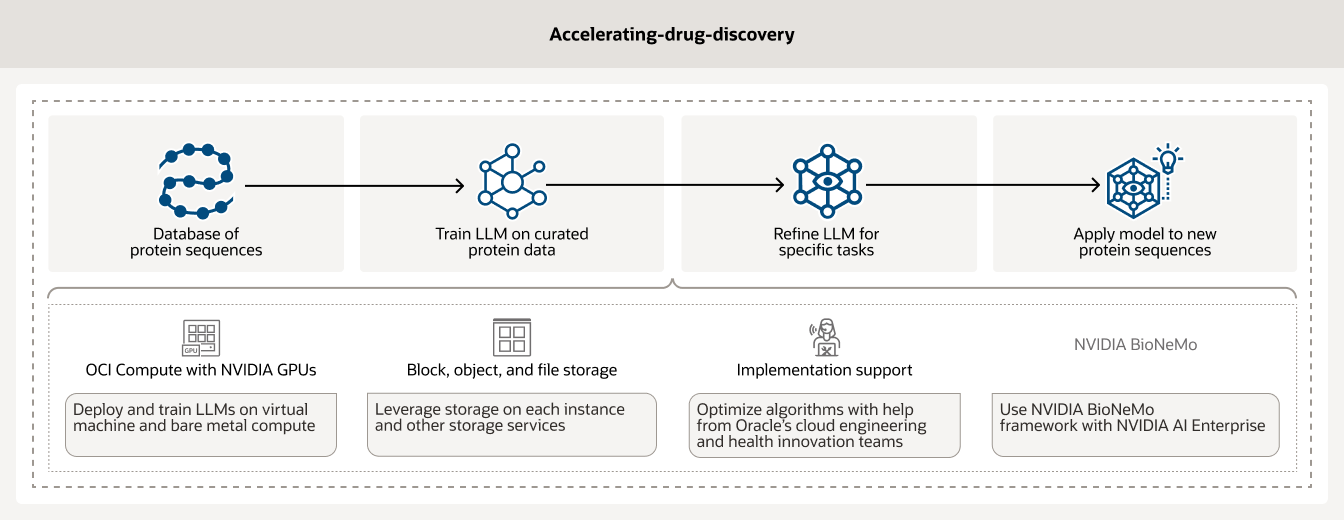

- Uso de IA para acelerar a descoberta de medicamentos

Treine modelos de IA em instâncias bare metal da OCI com GPUs, rede de cluster RDMA e o OCI Data Science.

Proteger os bilhões de transações financeiras que acontecem todos os dias requer ferramentas aprimoradas de IA que possam analisar grandes quantidades de dados históricos dos clientes. Os modelos de IA executados no OCI Compute com GPUs NVIDIA, juntamente com ferramentas de gerenciamento de modelos, como o OCI Data Science e outros modelos de código aberto, ajudam as instituições financeiras a mitigar fraudes.

A IA é frequentemente usada para analisar vários tipos de imagens médicas (como raios-X e ressonâncias magnéticas) em um hospital. Modelos treinados podem ajudar a priorizar casos que precisam de revisão imediata por um radiologista e relatar resultados conclusivos sobre outros.

A descoberta de medicamentos é um processo demorado e caro que pode levar muitos anos e custar milhões de dólares. Utilizando a infraestrutura e a análise de IA, os pesquisadores podem acelerar a descoberta de medicamentos. Além disso, o OCI Compute com GPUs NVIDIA, juntamente com ferramentas de gerenciamento de fluxo de trabalho de IA, como BioNeMo, permite que os clientes selecionem e pré-processem seus dados.

Conheça a infraestrutura de IA da OCI

Acesse especialistas em assuntos de IA

Receba ajuda para criar sua próxima solução de IA ou implementar sua carga de trabalho na infraestrutura de IA da OCI.

-

Eles podem responder a perguntas como:

- Como começar a usar a Oracle Cloud?

- Que tipos de cargas de trabalho de IA posso executar na OCI?

- Quais tipos de serviços de IA a OCI oferece?

Veja como aplicar IA hoje mesmo

Entre em uma nova era de produtividade com soluções de IA generativas para sua empresa. Saiba como a Oracle ajuda os clientes a aproveitar a IA incorporada em toda a pilha de tecnologia.

-

O que você pode alcançar com o Oracle AI?

- Ajuste LLMs na OCI

- Automatize o processamento de faturas

- Crie um chatbot com RAG

- Resuma conteúdo da web com IA generativa

- E muito mais!

Recursos adicionais

Saiba mais sobre rede de cluster RDMA, instâncias de GPU, servidores bare metal e muito mais.

Veja o quanto pode você pode economizar com a OCI

Os preços da Oracle Cloud são simples, com preço baixo consistente em todo o mundo, oferecendo suporte a uma ampla gama de casos de uso. Para estimar a sua taxa, consulte a estimativa de custos e configure os serviços para atender às suas necessidades.

Experimente a diferença

- 1/4 dos custos de largura de banda de saída

- 3X o custo-benefício de computação

- Mesmo preço em todas as regiões

- Preços baixos sem compromissos de longo prazo