תשתית AI

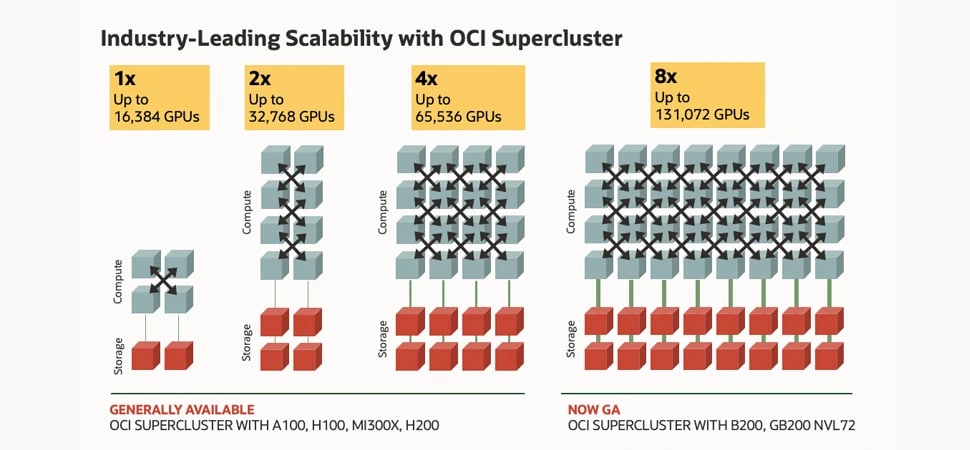

הריצו עומסי עבודה תובעניים מהר יותר, כולל אימון והסקה של מודלים בקו הקדמי, סוכני בינה מלאכותית, מחשוב מדעי ומערכות המלצה, בכל מקום בענן המבוזר שלנו. השתמשו ב-Oracle Cloud Infrastructure (OCI) Supercluster לעד 131,072 יחידות עיבוד גרפי עבור ביצועים ב-zettascale.

-

![]() גלו מהן מגמות הבינה המלאכותית שישפיעו על עסקים ב-2026

גלו מהן מגמות הבינה המלאכותית שישפיעו על עסקים ב-2026

הצטרפו לסדרת הוובינרים שלנו כדי ללמוד כיצד הארגון שלכם יכול להמשיך להיות מוכן.

-

![]() עקרונות ראשונים: Zettascale OCI Superclusters

עקרונות ראשונים: Zettascale OCI Superclusters

האדריכלים המובילים של OCI חושפים כיצד רשתות אשכולות מניעות GenAI שניתנת להרחבה - ממספר מעבדי GPU ועד OCI Supercluster zettascale עם 131,072 מעבדי GPU של NVIDIA Blackwell.

![]() בינה מלאכותית בפעולה: 10 חידושים פורצי דרך שכדאי לחקור עכשיו

בינה מלאכותית בפעולה: 10 חידושים פורצי דרך שכדאי לחקור עכשיו

גלו 10 טכנולוגיות פורצות דרך המונעות על ידי בינה מלאכותית שמעצבות מחדש את האופן שבו ארגונים מבצעים תחזוקה, מתקשרים עם לקוחות, מאבטחים נתונים, מספקים שירותי בריאות ועוד.

-

![]() קבוצת אסטרטגיות ארגוניות של AMD Instinct MI300X

קבוצת אסטרטגיות ארגוניות של AMD Instinct MI300X

גלו את פרספקטיבת האנליסטים על תשתית OCI AI עם מעבדי AMD GPU וכיצד שילוב זה יכול לשפר את הפרודוקטיביות, להאיץ את הזמן לערך ולהוזיל את עלויות האנרגיה.

חדשנות משותפת של Oracle ו-NVIDIA

גלו כיצד שתי החברות מאיצות את אימוץ הבינה המלאכותית.

היתרונות של תשתית OCI לבינה מלאכותית

ביצועים וערך

שפרו את הכשרת הבינה המלאכותית באמצעות מופעי המתכת החשופה הייחודיים של ה-GPU ב-OCI ורישות אשכולות RDMA מהיר במיוחד, המפחיתים את זמן ההמתנה ל-2.5 מיקרו-שניות בלבד. קבלו תמחור טוב יותר למחשבים וירטואליים של GPU.

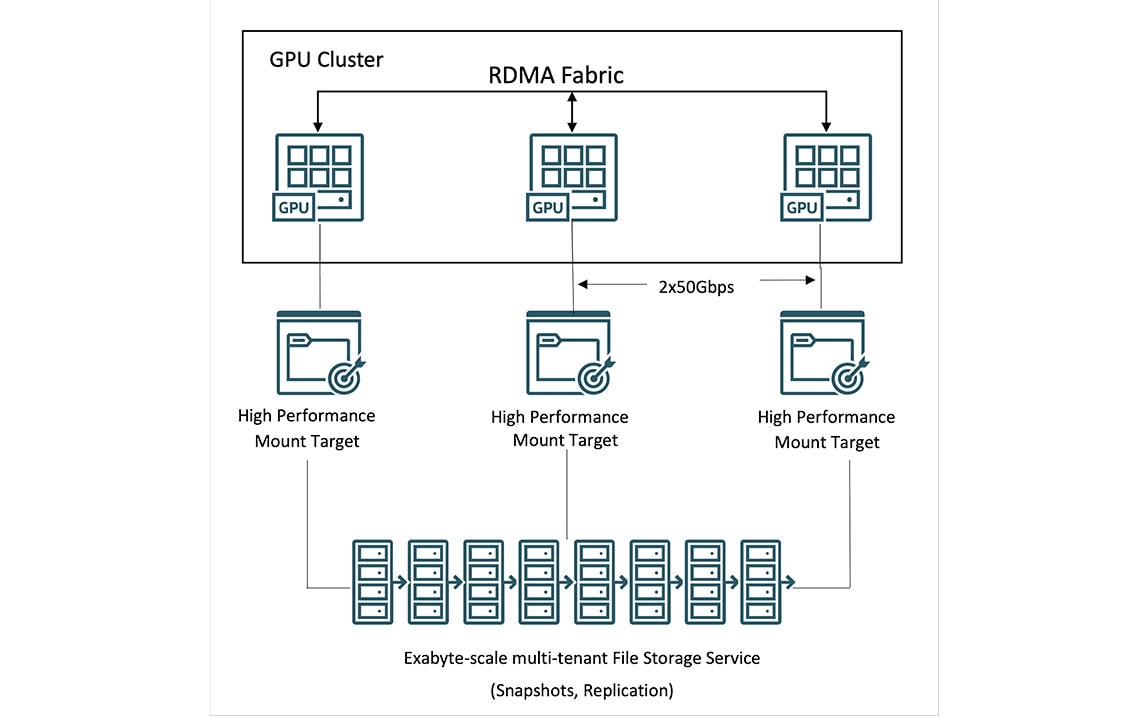

אחסון HPC

מנפו את OCI File Storage עם יעדי טעינה בעלי ביצועים גבוהים (HPMTs) ו-Lustre עבור טרהבייטים לשנייה של התפוקה. השתמשו באחסון של NVMe בנפח של עד 61.44 טרהבייט, הגדול ביותר בתעשייה עבור מופעי GPU.

בינה מלאכותית ריבונית

הענן המבוזר של Oracle מאפשר לפרוס את תשתית הבינה המלאכותית בכל מקום כדי לעמוד בדרישות הביצועים, האבטחה והריבונות . למדו כיצד Oracle ו-NVIDIA מספקות בינה מלאכותית ריבונית בכל מקום.

התמונה מציגה תיבות המייצגות מחשוב ואחסון, והן מחוברות באמצעות קווים לרישות אשכולות. בצד שמאל הרחוק, ישנן ארבע תיבות מחשוב ושתיים לאחסון עבור האשכול הקטן ביותר עם 16,000 יחידות GPU של NVIDIA H100. בצד ימין יש 8 תיבות מחשוב ו-4 תיבות אחסון עבור 32,000 יחידות GPU של NVIDIA A100 באשכול. לאחר מכן, ישנן 16 תיבות מחשוב ו-8 תיבות אחסון עבור 64,000 יחידות GPU של NVIDIA H200. לבסוף, בקצה הימני, יש 32 תיבות של מחשוב ו-16 תיבות של אחסון עבור 128,000 יחידות GPU של NVIDIA Blackwell ו-Grace Blackwell. זה מראה שיכולת ההרחבה של OCI Supercluster גדלה פי 8 מהתצורה הקטנה ביותר של 16,000 יחידות GPU בקצה השמאלי עד לתצורה הגדולה ביותר של 128,000 יחידות GPU בקצה הימני.

התמונה מציגה תיבות המייצגות מחשוב ואחסון, והן מחוברות באמצעות קווים לרישות אשכולות. בצד שמאל הרחוק, ישנן ארבע תיבות מחשוב ושתיים לאחסון עבור האשכול הקטן ביותר עם 16,000 יחידות GPU של NVIDIA H100. בצד ימין יש 8 תיבות מחשוב ו-4 תיבות אחסון עבור 32,000 יחידות GPU של NVIDIA A100 באשכול. לאחר מכן, ישנן 16 תיבות מחשוב ו-8 תיבות אחסון עבור 64,000 יחידות GPU של NVIDIA H200. לבסוף, בקצה הימני, יש 32 תיבות של מחשוב ו-16 תיבות של אחסון עבור 128,000 יחידות GPU של NVIDIA Blackwell ו-Grace Blackwell. זה מראה שיכולת ההרחבה של OCI Supercluster גדלה פי 8 מהתצורה הקטנה ביותר של 16,000 יחידות GPU בקצה השמאלי עד לתצורה הגדולה ביותר של 128,000 יחידות GPU בקצה הימני.

OCI Supercluster עם NVIDIA Blackwell ויחידות GPU של Hopper

עד 131,072 מעבדי GPU, פי 8 יותר יכולת התרחבות

חידושי מארג רשתות יאפשרו ל-OCI Supercluster להתרחב עד 131,072 מעבדי GPU של NVIDIA B200 ויותר מ-100,000 מעבדי GPU של Blackwell ב-NVIDIA Grace Blackwell Superchips ו-65,536 מעבדי NVIDIA H200 GPU.

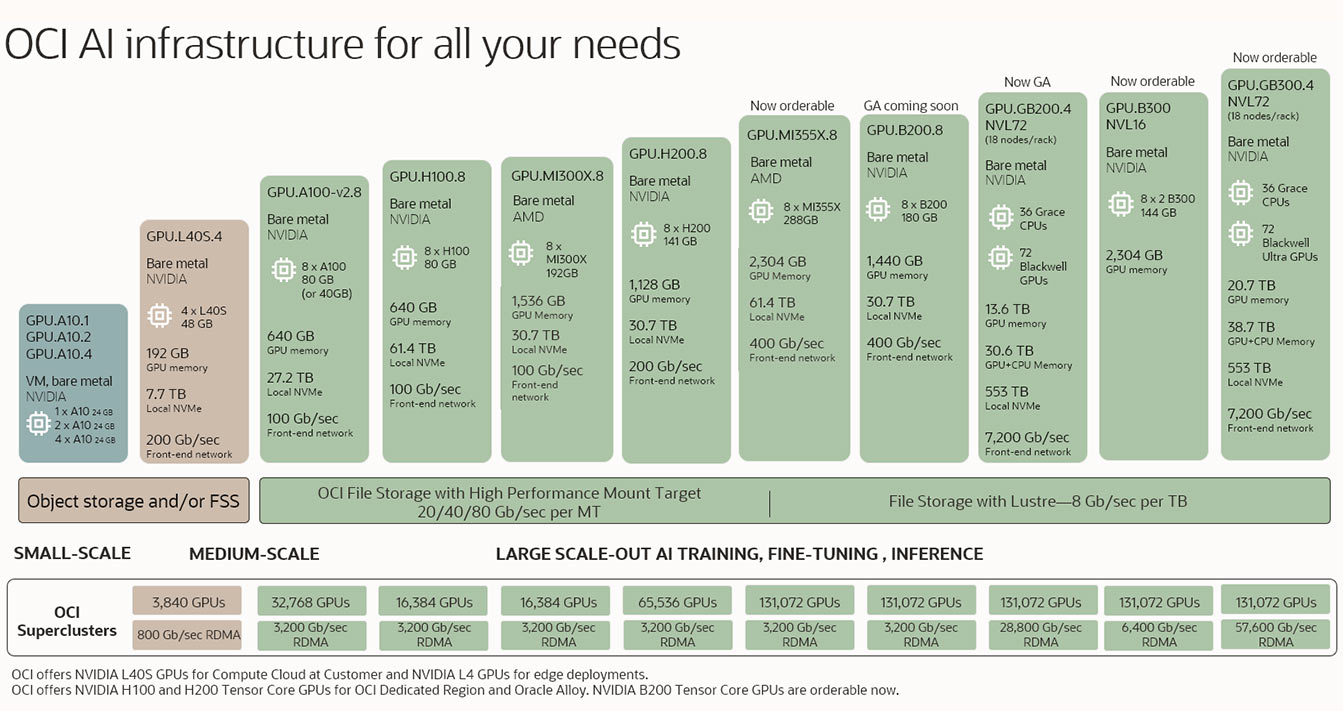

תשתית בינה מלאכותית OCI לכל הצרכים שלכם

מהסקה וכוונון ועד אימון מודלים של בינה מלאכותית גנרטיבית בקנה מידה גדול, OCI מציעה אשכולות GPU וירטואליים ופיזיים מהמובילים בתעשייה, הפועלים על גבי רשת ברוחב פס גבוה במיוחד ועם אחסון עתיר-ביצועים שיתאים לכל צורכי הבינה המלאכותית שלכם.

התמונה מציגה מספר מוצרים לתשתית בינה מלאכותית החל בחלק השמאלי התחתון עם התצורות הקטנות ביותר, ולאחר מכן ובהדרגה עוברים לתצורות בקנה מידה בינוני ובקנה מידה גדול. התצורות הקטנות ביותר הן עם יחידת GPU אחת בלבד במחשב וירטואלי והתצורות הגדולות ביותר מיועדות ליותר מ-100,000 יחידות GPU באשכולות RDMA.

התמונה מציגה מספר מוצרים לתשתית בינה מלאכותית החל בחלק השמאלי התחתון עם התצורות הקטנות ביותר, ולאחר מכן ובהדרגה עוברים לתצורות בקנה מידה בינוני ובקנה מידה גדול. התצורות הקטנות ביותר הן עם יחידת GPU אחת בלבד במחשב וירטואלי והתצורות הגדולות ביותר מיועדות ליותר מ-100,000 יחידות GPU באשכולות RDMA. הכרזה על הזמינות המסחרית של OCI Compute עם מעבדי AMD MI355X GPU

גלו את OCI Supercluster לאימון בינה מלאכותית בקנה מידה גדול

אשכולות מורחבים בקנה מידה גדול עם NVIDIA Blackwell ו-Hopper

מחשוב מתקדם במיוחד

• מופעי מתכת חשופה ללא תקורת היפרויזור כלשהי

• האצה על ידי NVIDIA Blackwell (GB200 NVL72, HGX B200),

Hopper (H200, H100), ומעבדי GPU מהדור הקודם

• אפשרות להשתמש במעבדי GPU של AMD MI300X

• יחידת עיבוד נתונים (DPU) להאצת חומרה מובנית

קיבולת מסיבית ואחסון עם תפוקה גבוהה

• אחסון מקומי: עד 61.44 טרהבייט של NVMe קיבולת כונן SSD

• אחסון קבצים: אחסון קבצים מנוהל על ידי Oracle עם Lustre ונקודות עיגון ביעד עם ביצועים גבוהים.

• אחסון בבלוק: אחסון מאוזן, ביצועים טובים יותר ונפחי ביצועים גבוהים במיוחד עם SLA

• אחסון אובייקטים: שכבות סיווג אחסון מובחנות, שכפול קופסאות אחסון ומגבלות קיבולת גבוהות

רישות מהיר במיוחד

• RDMA מותאם אישית באמצעות פרוטוקול Ethernet אחוד (RoCE v2)

• 2.5 עד 9.1 מיקרו-שניות של זמן המתנה לעבודה ברשת אשכולות

• רוחב פס של רשת אשכולות עד 3,200 ג'יגה לשנייה

• רוחב פס של רשת אשכולות עד 400 ג'יגה לשנייה במחשב הלקוח

מחשוב ל-OCI Supercluster

מופעי מתכת חשופה של OCI המופעלים על ידי NVIDIA GB200 NVL72, NVIDIA B200, NVIDIA H200, AMD MI300X, NVIDIA L40S, NVIDIA H100 ו-NVIDIA A100 GPUs מאפשרים להריץ מודלים גדולים של בינה מלאכותית לתרחישי שימוש הכוללים למידה עמוקה, בינה מלאכותית לשיחה ובינה מלאכותית גנרטיבית.

עם OCI Supercluster, ניתן להתרחב עד 100,000 GB200 Superchips, 131,072 B200 GPUs, 65,536 H200 GPUs, 32,768 A100 GPUs, 16,384 H100 GPUs, 16,384 MI300X GPUs, ו 3,840 L40S GPUs לאשכול.

להגדיל+

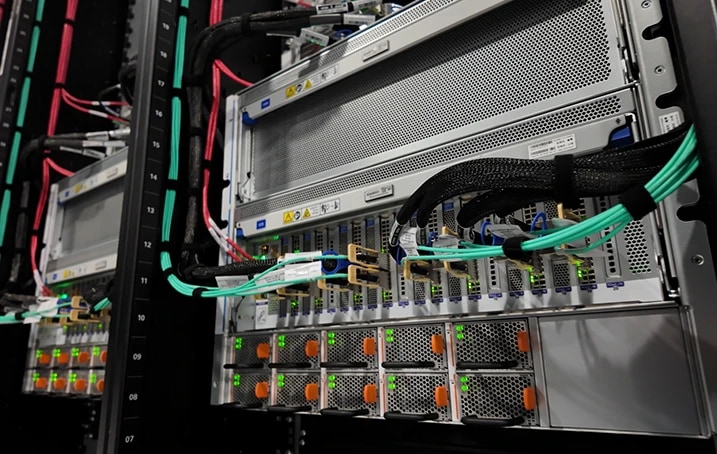

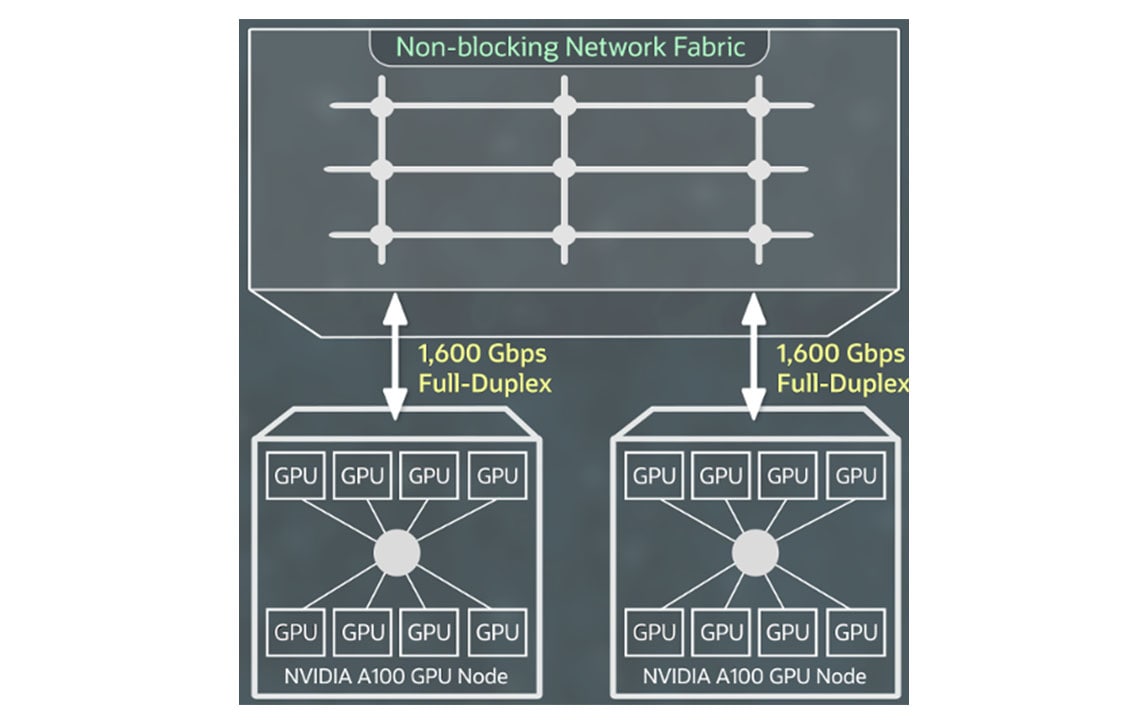

רישות עבור OCI Supercluster

עבודה ברשת אשכולות RDMA במהירות גבוהה המופעלת על ידי כרטיסי ממשק רשת מסוג NVIDIA ConnectX עם RDMA over Converged Ethernet גרסה 2 מאפשרת ליצור אשכולות גדולים של מופעי GPU עם אותו רישות בזמן המתנה נמוך במיוחד ויכולת הרחבת יישומים הצפויה באתר הלקוח.

הלקוחות לא משלמים תוספת עבור יכולות RDMA, אחסון בלוקים או רוחב פס, והם מקבלים תעבורה יוצאת בנפח 10GB בחינם.

להגדיל+

אחסון עבור OCI Supercluster

OCI Supercluster מאפשר ללקוחות לגשת לאחסון מקומי, אחסון בבלוקים, אחסון אובייקטים ואחסון קבצים למחשוב בקנה מידה של פטהבייט. מבין ספקי ענן הגדולים, OCI מציעה את הקיבולת הגבוהה ביותר של אחסון NVMe מקומי עתיר-ביצועים לשמירת גיבויים תכופה יותר במהלך האימון, מה שמוביל להתאוששות מהירה יותר במקרה של תקלה.

עבור מערכי נתונים מסיביים, OCI מציע אחסון קבצים בעל ביצועים גבוהים עם שירות Lustre ויעדי טעינה. מערכות קבצים במחשוב עתיר ביצועים, כולל BeeGFS, GlusterFS ו-WEKA, יכולות לשמש לאימון בינה מלאכותית בקנה מידה גדול מבלי להתפשר על הביצועים.

Zettascale OCI Superclusters

צפו באדריכלים המובילים של OCI חושפים כיצד רשתות אשכולות מפעילות בינה מלאכותית גנרטיבית ניתנת להרחבה. ממספר מעבדי GPU ועד Zettascale OCI Superclusters עם יותר מ-131,000 מעבדי GPU של NVIDIA Blackwell, רשתות אשכולות מספקות מהירות גבוהה, זמן המתנה קצר ורשת עמידה למסע הבינה המלאכותית שלכם.

Seekr בוחרת ב-Oracle Cloud Infrastructure כדי לספק בינה מלאכותית מהימנה ללקוחות ארגוניים וממשלתיים ברחבי העולם

אייבל הבטגורגיס, יחסי הציבור של OracleSeekr, חברת בינה מלאכותית המתמקדת באספקת בינה מלאכותית מהימנה, חתמה על הסכם רב-שנתי עם Oracle Cloud Infrastructure (OCI) כדי להאיץ במהירות פריסות בינה מלאכותית ארגוניות וכדי לבצע אסטרטגיה משותפת להשקה.

קראו את הפוסט המלאבלוגים מומלצים

- 26 במרץ 2025 הכרזה על יכולות חדשות של תשתית בינה מלאכותית עם NVIDIA Blackwell לענן ציבורי, מקומי ושל ספק שירות

- 17 במרץ 2025 קידום חדשנות בבינה מלאכותית: NVIDIA AI Enterprise ו-NVIDIA NIM ב-OCI

- 17 במרץ 2025 Oracle ו-NVIDIA מספקות בינה מלאכותית ריבונית בכל מקום

- 11 במרץ 2025 הפכו את הבינה המלאכותית שלכם מאפס לנכס - פרסו את עומסי העבודה שלכם בבינה המלאכותית במהירות על OCI

מקרי שימוש אופייניים בתשתית בינה מלאכותית

- למידה עמוקה, אימון והסקה

- זיהוי הונאה בסיוע בינה מלאכותית

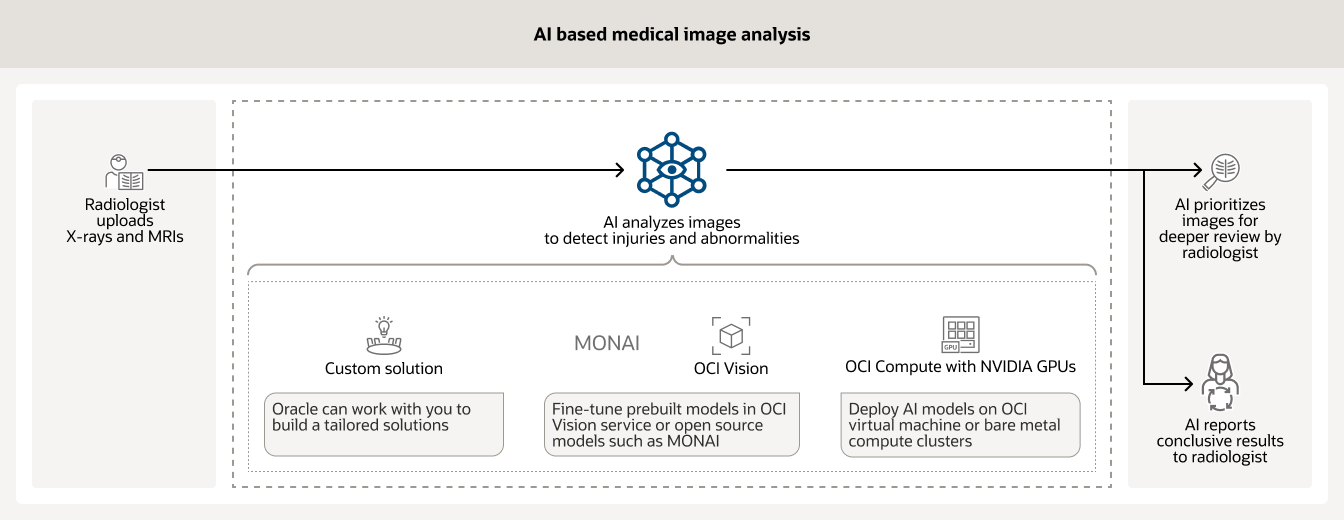

- ניתוח תמונות רפואיות בעזרת בינה מלאכותית

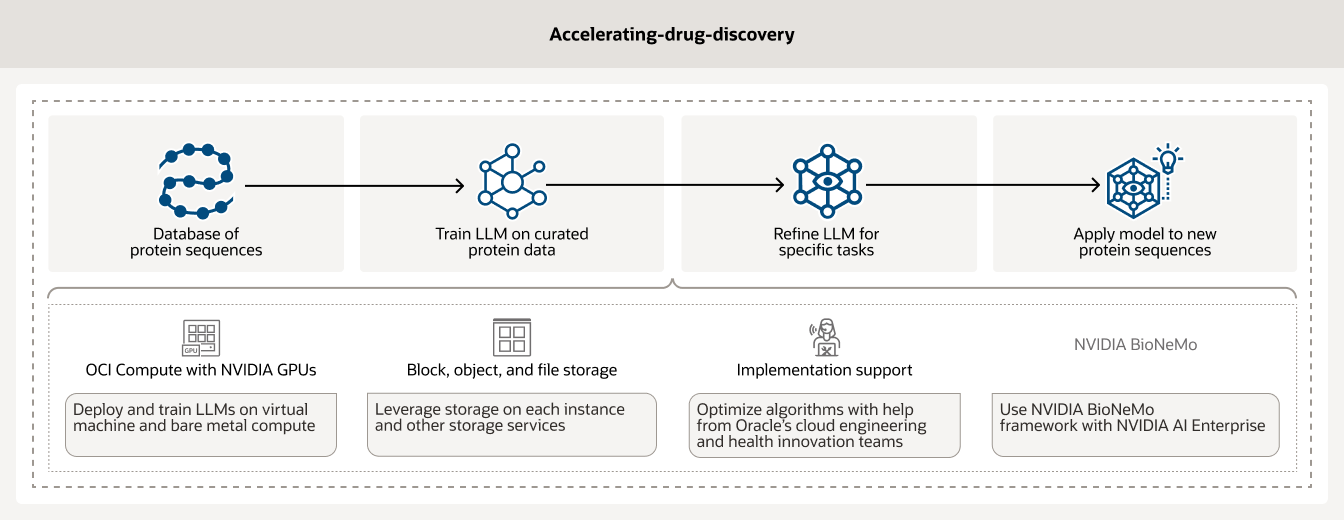

- שימוש בבינה מלאכותית כדי להאיץ את פיתוחן של תרופות

אמנו מודלים של בינה מלאכותית במופעי מתכת חשופה של OCI המופעלים על ידי מופעי GPU, רשת אשכולות RDMA ו-OCI Data Science.

מדי יום מתבצעות מיליארדי עסקאות פיננסיות. כדי להגן עליהן, יש צורך בכלי בינה מלאכותית מתקדמים שיכולים לנתח כמויות גדולות של נתוני לקוחות היסטוריים. מודלים של בינה מלאכותית ב-OCI Compute המופעלים על ידי מעבדי GPU של NVIDIA, יחד עם כלים לניהול מודלים כגון OCI Data Science ומודלים אחרים בקוד פתוח, עוזרים למוסדות פיננסיים להפחית את הסיכון להונאה.

בתי חולים רבים משתמשים בבינה מלאכותית כדי לנתח סוגים שונים של תמונות רפואיות (כמו צילומי רנטגן וסריקות MRI). מודלים ייעודיים יכולים לדווח על תוצאותיהן של בדיקות רפואיות ולהצביע על מקרים שדורשים בדיקה מיידית על ידי רדיולוג.

פיתוח תרופות הוא תהליך יקר וארוך שיכול לקחת שנים רבות ולעלות מיליוני דולרים. מינוף תשתית הבינה המלאכותית ויכולות האנליטיקס עוזר לחוקרים יכולים להאיץ את גילויין של תרופות חדשות. בנוסף, OCI Compute, המופעל על ידי מעבדי GPU של NVIDIA, יחד עם כלים לניהול זרימות עבודה של בינה מלאכותית כגון BioNeMo, מאפשר לאצור נתונים ולעבד אותם מראש.

צעדים ראשונים עם OCI AI Infrastructure

התייעצו עם מומחים לבינה מלאכותית

קבלו תמיכה בבניית פתרונות בינה מלאכותית או בפריסה של עומסי עבודה על תשתית OCI לבינה מלאכותית.

-

הם יכולים לענות על שאלות כגון

- כיצד אוכל להתחיל עם Oracle Cloud?

- אילו סוגים של עומסי עבודה אפשר להריץ ב-OCI?

- אילו סוגים של שירותי בינה מלאכותית כלולים ב-OCI?

גלו כיצד ליישם בינה מלאכותית היום

היכנסו לעידן חדש של פרודוקטיביות עם פתרונות בינה מלאכותית גרטיבית לעסק שלכם. למדו כיצד Oracle מסייעת ללקוחות למנף בינה מלאכותית משובצת במחסנית הטכנולוגיה המלאה.

-

מה תוכלו להשיג עם Oracle AI?

- כווננו מודלים של LLM ב-OCI

- הפכו לאת עיבוד החשבוניות לאוטומטי

- בנו צ'אטבוט עם RAG

- סכמו תכני רשת עם בינה מלאכותית גנרטיבית

- ועוד הרבה יותר!

משאבים נוספים

למדו עוד על רשת אשכולות RDMA, מופעי GPU, שרתי מתכת חשופה ועוד.

ראה כמה אתה יכול לחסוך עם OCI

התמחור של Oracle Cloud הוא פשוט, עם תמחור נמוך עקבי ברחבי העולם, התומך במגוון רחב של מקרי שימוש. כדי להעריך את התעריף הנמוך שלך, בדוק את אומדן העלויות והגדר את השירותים בהתאם לצרכיך.

חווה את ההבדל

- 1/4 בעלויות רוחב הפס היוצאות

- 3X המחיר-ביצועי החישוב

- אותו מחיר נמוך בכל אזור

- תמחור נמוך ללא התחייבויות לטווח ארוך